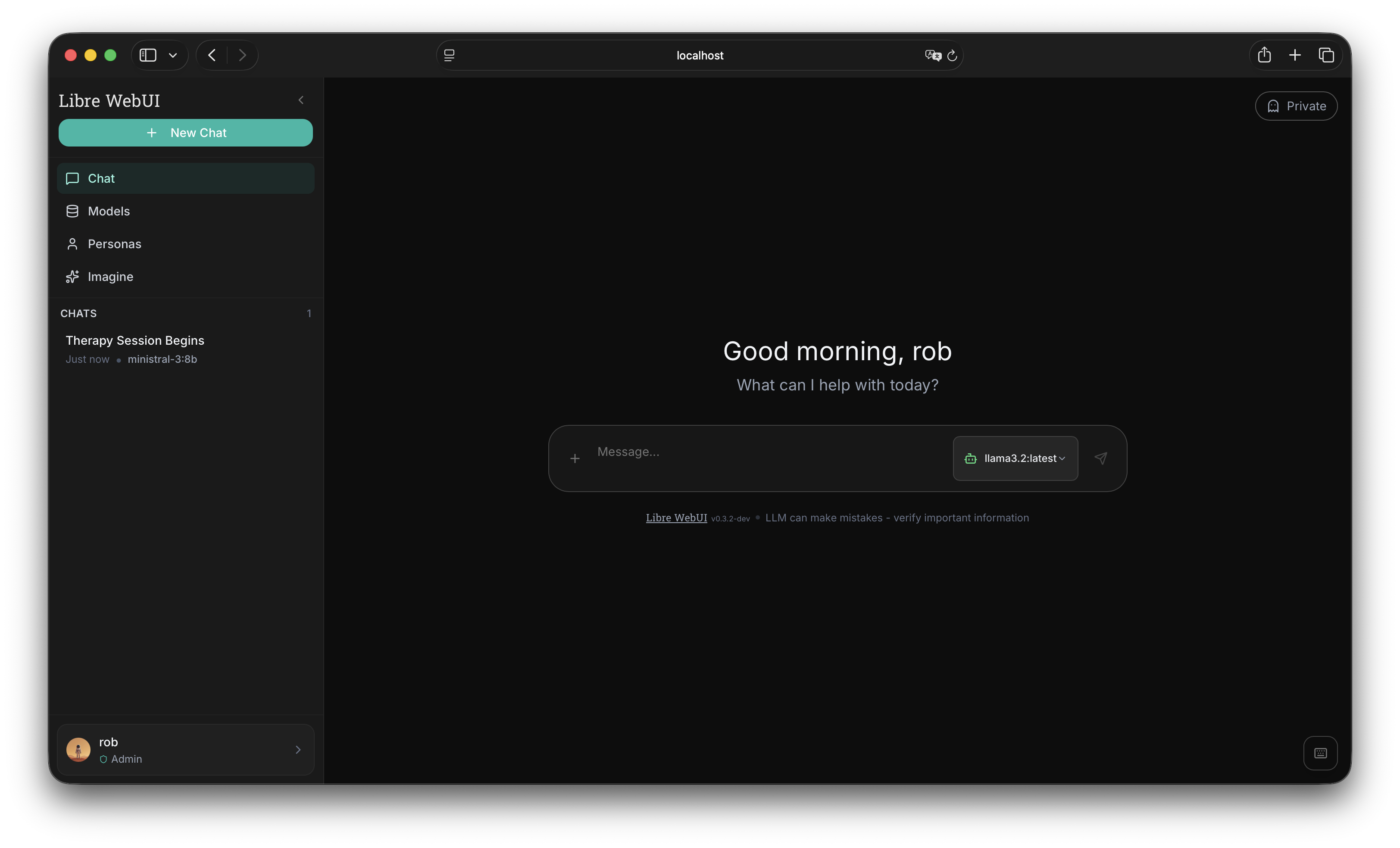

Votre IA, vos règles

Interface de chat IA axée sur la confidentialité. Exécutez localement avec Ollama ou connectez-vous à OpenAI, Anthropic et 9+ fournisseurs. Zéro télémétrie. Zéro suivi.

npx libre-webui Nécessite Node.js 18+ et Ollama pour l'IA locale

Tout ce dont vous avez besoin

Une solution de chat IA complète qui respecte votre vie privée

IA Locale et Cloud

Exécutez des modèles localement avec Ollama ou connectez-vous à OpenAI, Anthropic, Groq, Gemini, Mistral et plus. À vous de choisir.

Chat avec documents (RAG)

Téléchargez des PDF, documents et fichiers texte. Posez des questions sur vos documents avec recherche sémantique et embeddings vectoriels.

Artefacts interactifs

Rendez HTML, SVG et composants React directement dans le chat. Aperçu en direct avec mode plein écran.

Chiffrement AES-256

Chiffrement de niveau entreprise pour toutes vos données. Historique de chat, documents et paramètres chiffrés au repos.

Personas personnalisés

Créez des personnalités IA avec comportements uniques et prompts système. Import/export de personas en JSON.

Synthèse vocale

Écoutez les réponses IA avec plusieurs options de voix. Support TTS navigateur et intégration ElevenLabs.

Génération d'Images

Générez des images avec ComfyUI et les modèles Flux. Plusieurs tailles, préréglages de qualité et intégration fluide au chat.

Variables de Plugin

Paramètres configurables par plugin : température, endpoint, tokens, etc. Les valeurs sensibles sont chiffrées au repos.

Raccourcis clavier

Raccourcis inspirés de VS Code pour utilisateurs avancés. Naviguez, basculez les paramètres et contrôlez tout au clavier.

Support multi-utilisateurs

Contrôle d'accès basé sur les rôles avec support SSO. OAuth GitHub et Hugging Face intégré.

Connectez-vous à n'importe quel fournisseur

Une interface, des possibilités illimitées

Démarrez en quelques secondes

Choisissez votre méthode d'installation préférée

Créez des plugins personnalisés

Connectez n'importe quel LLM compatible OpenAI avec un simple fichier JSON

Plugins disponibles

Plugins officiels du dépôt Libre WebUI. Cliquez pour voir ou télécharger.

{

"id": "custom-model",

"name": "Custom Model",

"type": "completion",

"endpoint": "http://localhost:8000/v1/chat/completions",

"auth": {

"header": "Authorization",

"prefix": "Bearer ",

"key_env": "CUSTOM_MODEL_API_KEY"

},

"model_map": [

"my-fine-tuned-llama"

],

"variables": [

{

"name": "temperature",

"type": "number",

"label": "Temperature",

"default": 0.7,

"min": 0, "max": 2

}

]

}Créez votre propre plugin

Démarrez votre serveur LLM

Exécutez n'importe quel serveur compatible OpenAI : llama.cpp, vLLM, Ollama ou un serveur FastAPI personnalisé.

Créez le JSON du plugin

Définissez votre endpoint, authentification et modèles disponibles dans un simple fichier JSON.

Téléchargez vers Libre WebUI

Allez dans Paramètres > Fournisseurs, téléchargez votre plugin et entrez votre clé API.

Commencez à discuter

Vos modèles personnalisés apparaissent dans le sélecteur. Confidentialité totale, contrôle total.

Référence des champs de plugin

id Identifiant unique (minuscules, tirets autorisés) name Nom affiché dans l'interface type "completion" pour chat, "tts" pour synthèse vocale endpoint URL API (ex: /v1/chat/completions) auth.header En-tête d'auth (Authorization, x-api-key) auth.prefix Préfixe de clé ("Bearer " ou vide) auth.key_env Variable d'environnement pour votre clé API model_map Tableau des identifiants de modèles disponibles variables Paramètres configurables (température, endpoint, etc.) Prêt à posséder votre IA ?

Rejoignez des milliers d'utilisateurs qui valorisent la confidentialité et le contrôle.