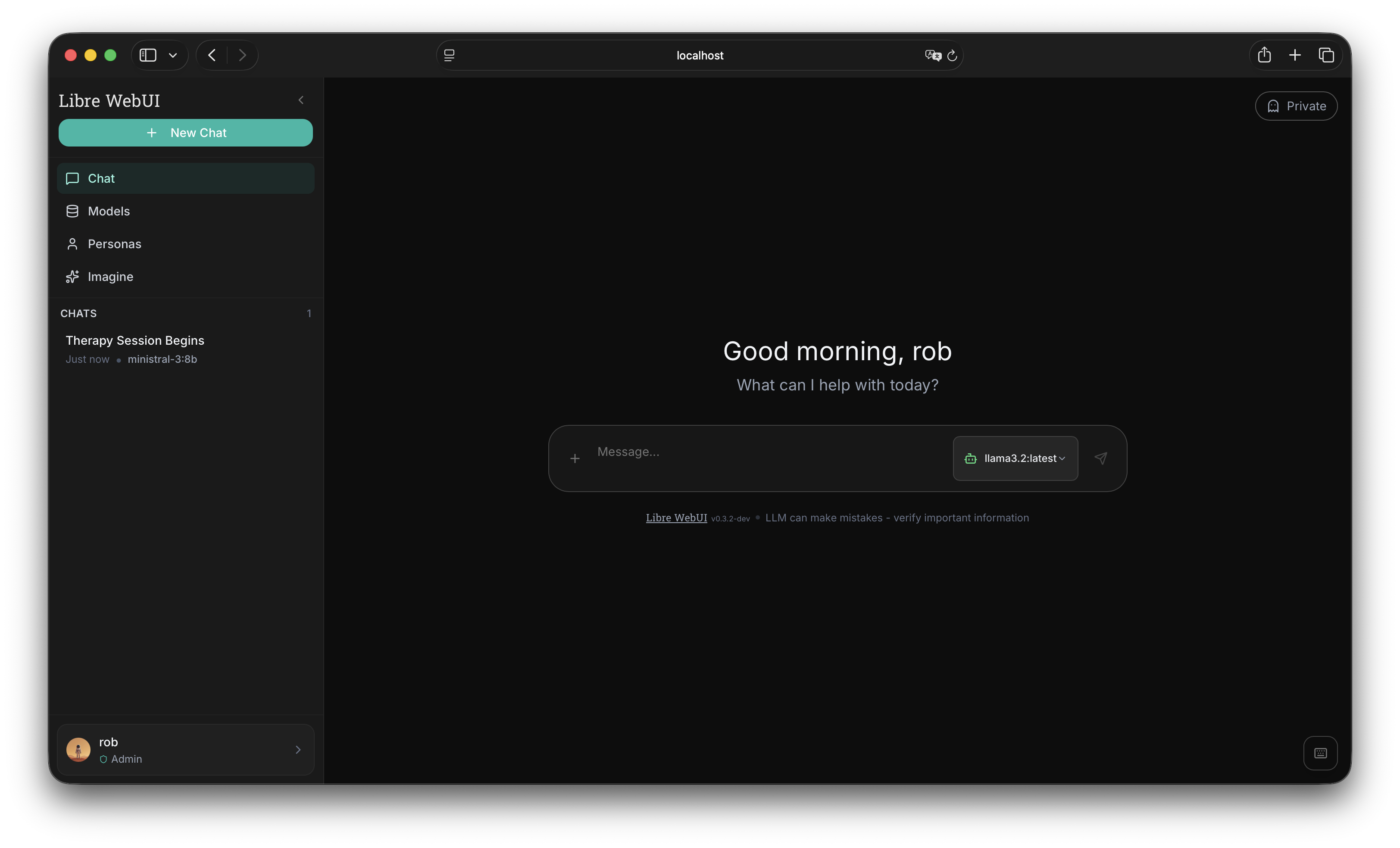

Ваш AI, ваши правила

Интерфейс AI-чата с приоритетом конфиденциальности. Запустите локально с Ollama или подключитесь к OpenAI, Anthropic и 9+ провайдерам. Ноль телеметрии. Ноль отслеживания.

npx libre-webui Требуется Node.js 18+ и Ollama для локального AI

Всё, что вам нужно

Полноценное AI-чат решение с уважением к конфиденциальности

Локальный и облачный AI

Запускайте модели локально с Ollama или подключайтесь к OpenAI, Anthropic, Groq, Gemini, Mistral и другим. Ваш выбор.

Чат с документами (RAG)

Загружайте PDF, документы и текстовые файлы. Задавайте вопросы по документам с семантическим поиском и векторными эмбеддингами.

Интерактивные артефакты

Рендеринг HTML, SVG и React компонентов прямо в чате. Предпросмотр с полноэкранным режимом.

Шифрование AES-256

Шифрование корпоративного уровня для всех данных. История чата, документы и настройки зашифрованы в состоянии покоя.

Персонализированные персоны

Создавайте AI-личности с уникальным поведением и системными промптами. Импорт/экспорт персон как JSON.

Синтез речи

Прослушивайте ответы AI с различными вариантами голоса. Поддержка браузерного TTS и интеграции ElevenLabs.

Генерация изображений

Создавайте изображения с помощью ComfyUI и моделей Flux. Различные размеры, пресеты качества и бесшовная интеграция с чатом.

Переменные плагинов

Настраиваемые параметры для каждого плагина: температура, эндпоинт, токены и др. Конфиденциальные значения шифруются при хранении.

Горячие клавиши

Сочетания клавиш в стиле VS Code для опытных пользователей. Навигация, переключение настроек и управление с клавиатуры.

Многопользовательская поддержка

Ролевой контроль доступа с поддержкой SSO. Встроенная OAuth-авторизация через GitHub и Hugging Face.

Подключение к любому провайдеру

Один интерфейс, безграничные возможности

Начните за секунды

Выберите предпочтительный способ установки

Создавайте свои плагины

Подключайте любой OpenAI-совместимый LLM с помощью простого JSON-файла

Доступные плагины

Официальные плагины из репозитория Libre WebUI. Нажмите для просмотра или скачивания.

{

"id": "custom-model",

"name": "Custom Model",

"type": "completion",

"endpoint": "http://localhost:8000/v1/chat/completions",

"auth": {

"header": "Authorization",

"prefix": "Bearer ",

"key_env": "CUSTOM_MODEL_API_KEY"

},

"model_map": [

"my-fine-tuned-llama"

],

"variables": [

{

"name": "temperature",

"type": "number",

"label": "Temperature",

"default": 0.7,

"min": 0, "max": 2

}

]

}Создайте свой плагин

Запустите LLM-сервер

Запустите любой OpenAI-совместимый сервер: llama.cpp, vLLM, Ollama или свой FastAPI-сервер.

Создайте JSON плагина

Определите endpoint, аутентификацию и доступные модели в простом JSON-файле.

Загрузите в Libre WebUI

Перейдите в Настройки > Провайдеры, загрузите плагин и введите API-ключ.

Начните общаться

Ваши модели появятся в селекторе моделей. Полная приватность, полный контроль.

Справочник полей плагина

id Уникальный идентификатор (строчные буквы, дефисы) name Отображаемое имя в интерфейсе type "completion" для чата, "tts" для синтеза речи endpoint URL API (например, /v1/chat/completions) auth.header Заголовок авторизации (Authorization, x-api-key) auth.prefix Префикс ключа ("Bearer " или пусто) auth.key_env Переменная окружения для API-ключа model_map Массив доступных идентификаторов моделей variables Настраиваемые параметры (температура, эндпоинт и т.д.) Готовы владеть своим AI?

Присоединяйтесь к тысячам пользователей, которые ценят конфиденциальность и контроль.